Sự việc tính năng “Share Chat” của OpenAI trên ChatGPT vừa rồi là một cú sốc khá lớn, khiến cho cộng đồng xôn xao. Hàng nghìn đoạn chat riêng tư bất ngờ “lên sóng” Google Search ( có nghĩa là chúng ta có thể search nó trên Google bằng một cách rất đơn giản) , làm người dùng đi từ hoang mang cho đến lo lắng.

1. Cái Checkbox “định mệnh”

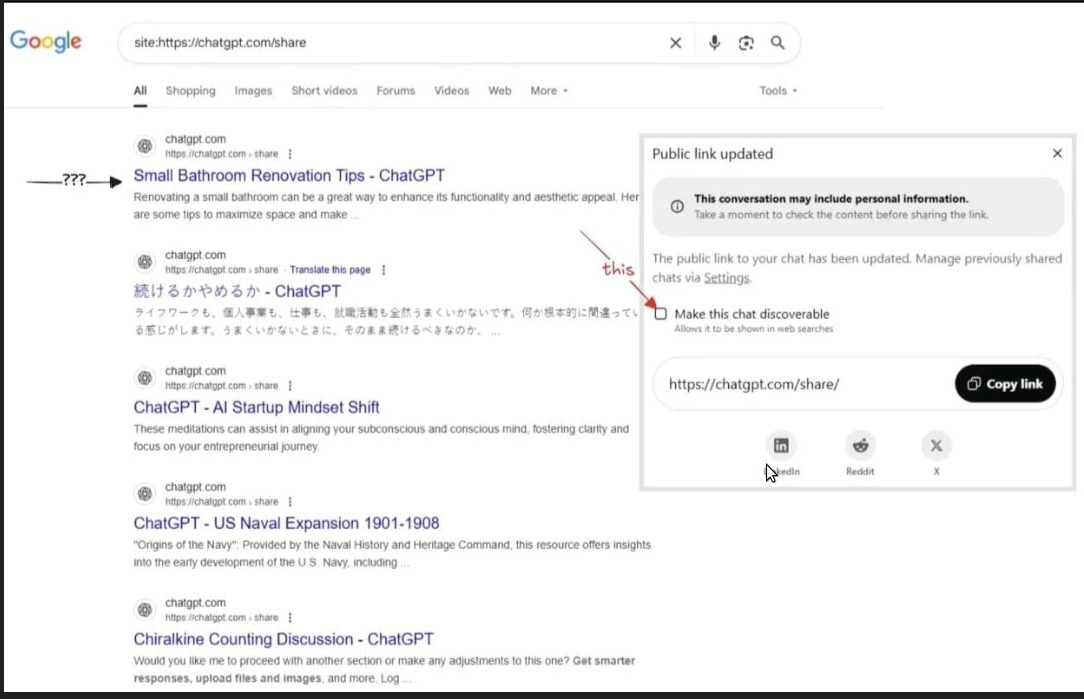

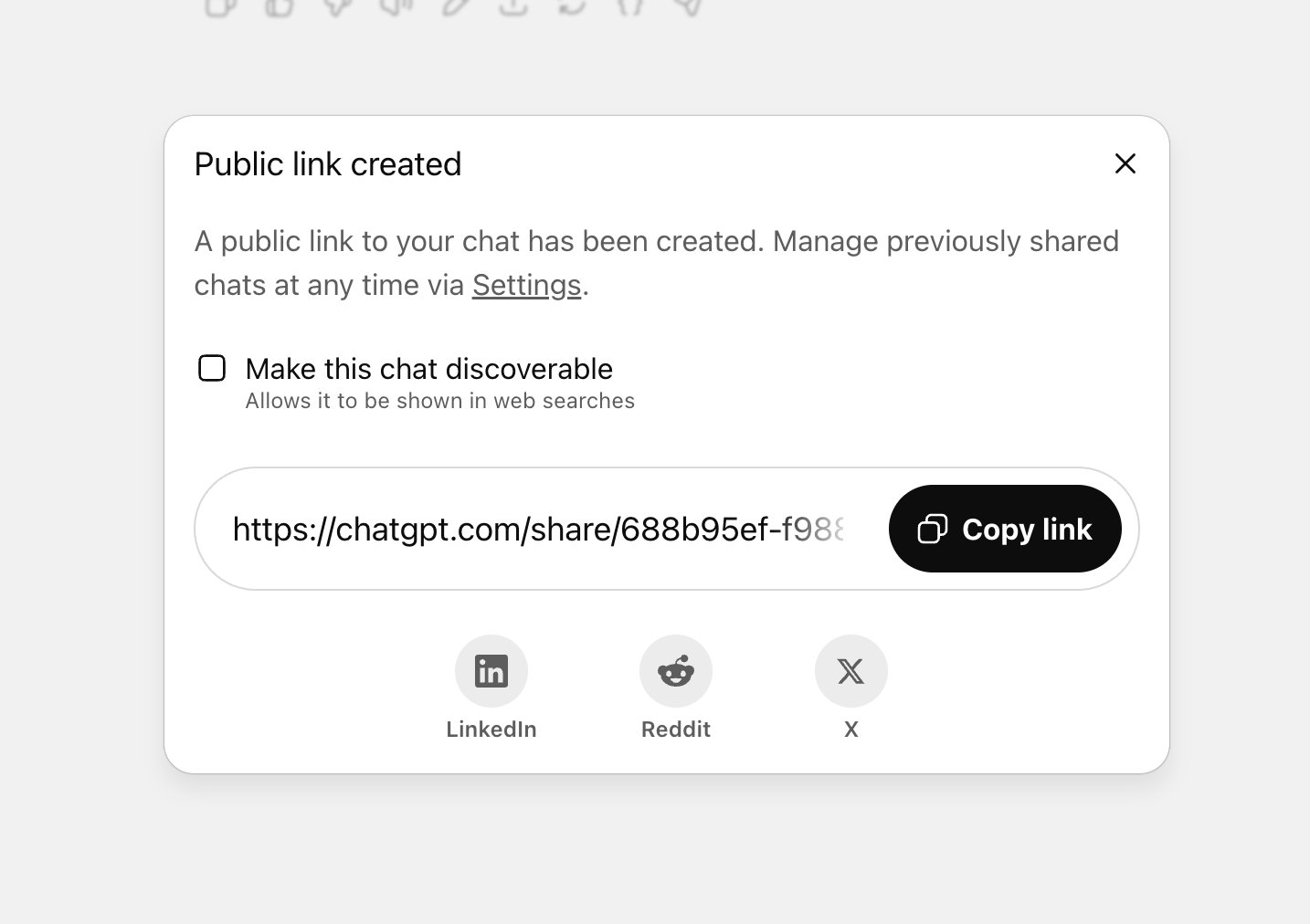

OpenAI ra mắt tính năng “Share Chat”, cho phép người dùng chia sẻ cuộc trò chuyện của mình với ChatGPT qua một link chia sẻ. Nghe thì có vẻ nó rất tiện, nhưng vấn đề nằm ở cái checkbox “Make this chat discoverable”. Khi tick vào đây, chat của bạn có thể sẽ xuất hiện trên Google.

Vấn đề là cảnh báo này chỉ có 1 dòng chữ bé tí, với đa phần người dùng họ sẽ rất dễ bỏ qua và không để ý sẽ dẫn tới câu chuyện. Rất nhiều người tưởng chỉ gửi link cho bạn bè đồng nghiệp, nhưn ai ngờ đâu cả thế giới đều có thể xem được.

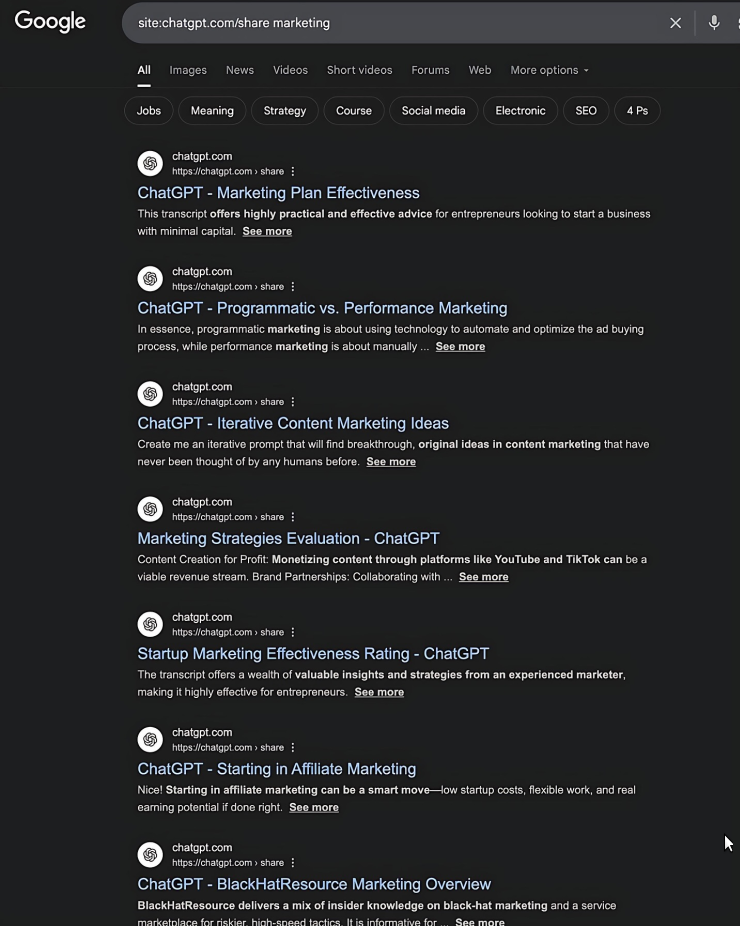

- Mistake??: OpenAI không gắn thẻ “noindex” cho các link được chia sẻ, nên Googlebot vô tư thu thập, đưa hơn 4.500 đoạn chat lên kết quả tìm kiếm. Chỉ cần gõ 1 câu đơn giản “site:chatgpt.com/share” là thấy cả 1 kho đoạn chat được chia sẻ. Tính năng mới ra này sống chưa đầy tháng đã gây drama lớn, đúng kiểu “chưa kịp hot đã flop”.

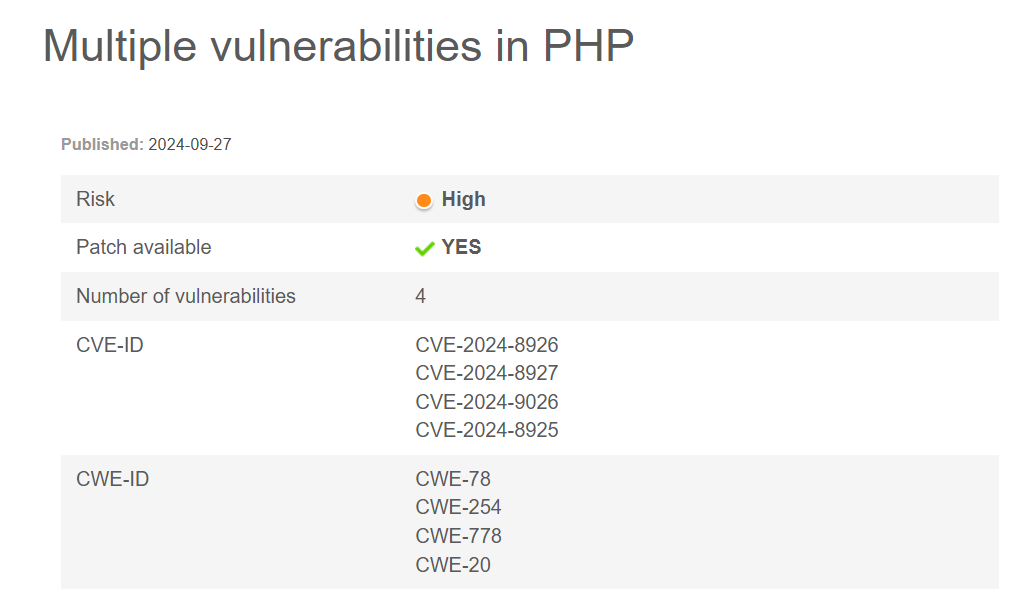

- Vụ này y hệt như lỗi của Google Bard năm 2023, khi các đoạn chat cũng bị lộ. OpenAI dường như không rút kinh nghiệm từ đối thủ, nên mới có màn “lặp lại lịch sử” này.

2. Rồi cái gì bị lộ?

Hơn 4.500 đoạn chat bị Google index, chứa đủ thứ từ chuyện cá nhân đến bí mật công việc.

| Nội dung | Mô tả | Số lượng (ước tính) | Tác động |

|---|---|---|---|

| Thông tin cá nhân | Resume, tên, số điện thoại, chi tiết đời tư. | Hơn 4.500 link | Nguy cơ đánh cắp danh tính, lộ thông tin nhạy cảm. |

| Sức khỏe, đời sống | Tâm sự về tình yêu, sức khỏe, thậm chí chuyện dùng chất kích thích. | ~20-30% tổng số | Cá nhân, tâm lý |

| Bí mật công ty | Kế hoạch kinh doanh, source code, chiến lược nội bộ. | ~10-15% | Lợi thế cạnh tranh, rủi ro pháp lý, lộ tài sản trí tuệ |

| Nội dung nhạy cảm khác | Chat về chuyện gia đình, thậm chí hoạt động bất hợp pháp. | N/A | Rủi ro kiện tụng, ảnh hưởng cá nhân. |

Một số đoạn chat không cần login vẫn xem được, nghĩa là ai cũng có thể thấy. Có những đoạn chat còn bị lưu trên các hệ thống archive như Wayback Machine, muốn xóa được cũng k phải đơn giản. Rất nhiều người trên X kêu ca: “Tưởng chat riêng, hóa ra cả làng biết! :)))” Một khảo sát nhỏ cho thấy 60% người dùng lo lắng về vấn đề “bảo mật” AI sau vụ này.

3. OpenAI và Google xử lý ra sao?

OpenAI vừa nghe tin đã vội “tắt nút” tính năng “Make this chat discoverable” trong vòng 1-2 ngày (khoảng 1-2/8/2025) có thể nói giống như meme huyền thoại “rút điện để chống hacker” của BKAV hồi nào đó.

Họ làm việc với Google để gỡ các link khỏi kết quả tìm kiếm, kiểu như “cứu vớt danh dự” vậy. Google đã hỗ trợ rất nhanh chóng, nhưng vài link vẫn lởn vởn đâu đó, làm người dùng vẫn hơi hoang mang, bởi vì

- OpenAI gọi đây chỉ là “thí nghiệm ngắn hạn” và thừa nhận vấn đề trải nghiệm giao diện không clear, dễ gây hiểu lầm. Không phải hack hay leak, chỉ là lỗi thiết kế thôi, nhưng mà lỗi này “chất lượng cao” quá và cam kết sẽ cải thiện để tránh lặp lại.

Cách xử lý: Vào ChatGPT > Settings > Shared Links > Delete all. Nếu không làm nhanh thì có thể là cả thế giới đã biết bạn đang tâm sự như thế nào với ChatGPT :)))

Rachel Tobac (SocialProof Security) khen OpenAI phản ứng nhanh, nhưng bảo thiết kế kiểu này là “mời gọi rắc rối”.

Carissa Véliz (Đại học Oxford): “Công ty công nghệ cứ thích chạy nhanh, xong làm khổ người dùng”.

Simon Willison: “Một cái checkbox mà bảo vệ dữ liệu? Thôi đi!”

Cộng đồng X gọi đây là “vụ bê bối bảo mật năm 2025”, với bình luận kiểu: “Privacy không phải trò đùa”. Có người còn đùa: “Lần sau tui chat bằng giấy cho chắc!” =))))

4. Bài học

Vụ này như gióng lên 1 hồi chuông cảnh báo về việc sử dụng AI và có nhiều tình trạng lạm dụng nó. ChatGPT giờ được nhiều người sử dụng trong y tế, giáo dục, kinh doanh..etc, nên việc lộ dữ liệu là vấn đề cực kỳ lớn. Có thể sắp tớithế giới sẽ có quy định mới, như buộc gắn “noindex” mặc định hoặc thêm các bước xác nhận.

Với người sử dụng thì đừng quá tin AI như bạn thân và quá lạm dụng nó. Bất kỳ ai cũng vậy cần đọc kỹ hiểu kỹ trước khi sử dụng, hạn chế đưa những chuyện nhạy cảm, và xóa chat sau khi dùng xong. An toàn vẫn là trên hết, giống như câu nói “Không tin bố con ông nào cả”.

Sự việc này đúng là bài học nhớ đời, kiểu “tưởng nhỏ mà hóa to”! Chúng ta cần tự biết cách bảo vệ chính bản thân mình và công việc mình đang làm.